#LIDD : booter Linux sur un CPU 4004 de 1971, c’est possible… en plus de 4 jours

Le 25 septembre à 06h00

2 min

Next

Next

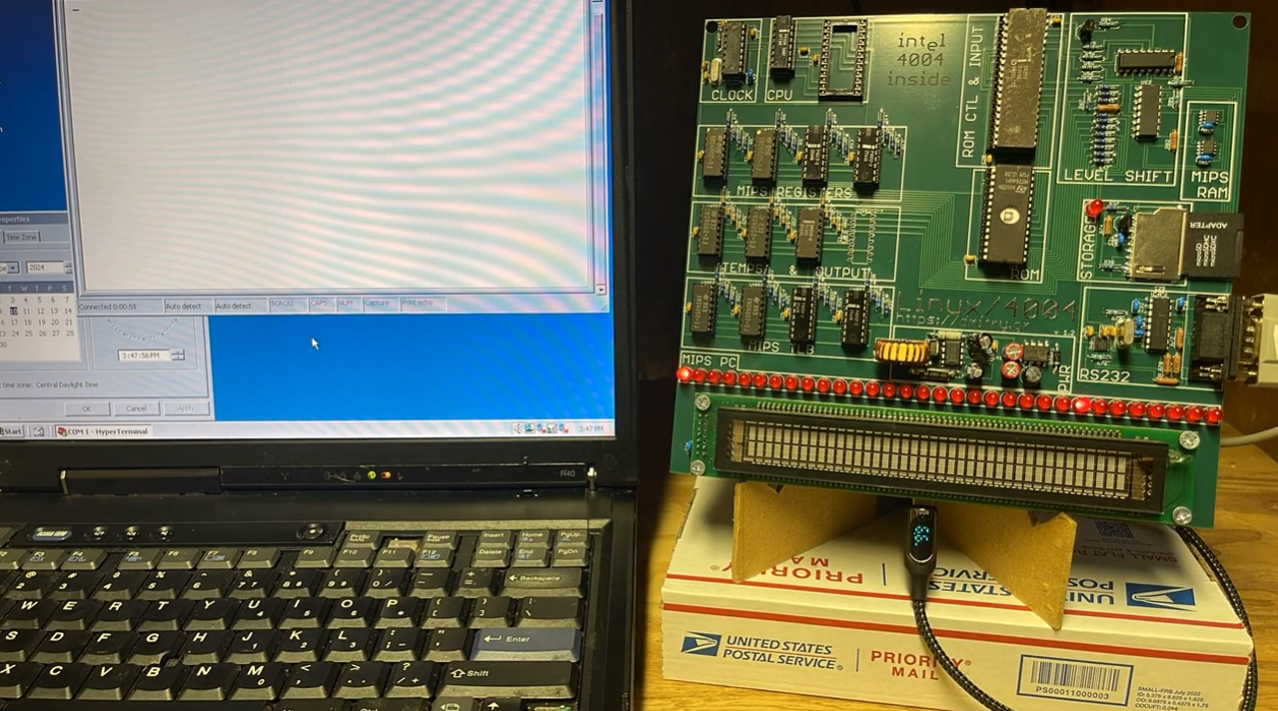

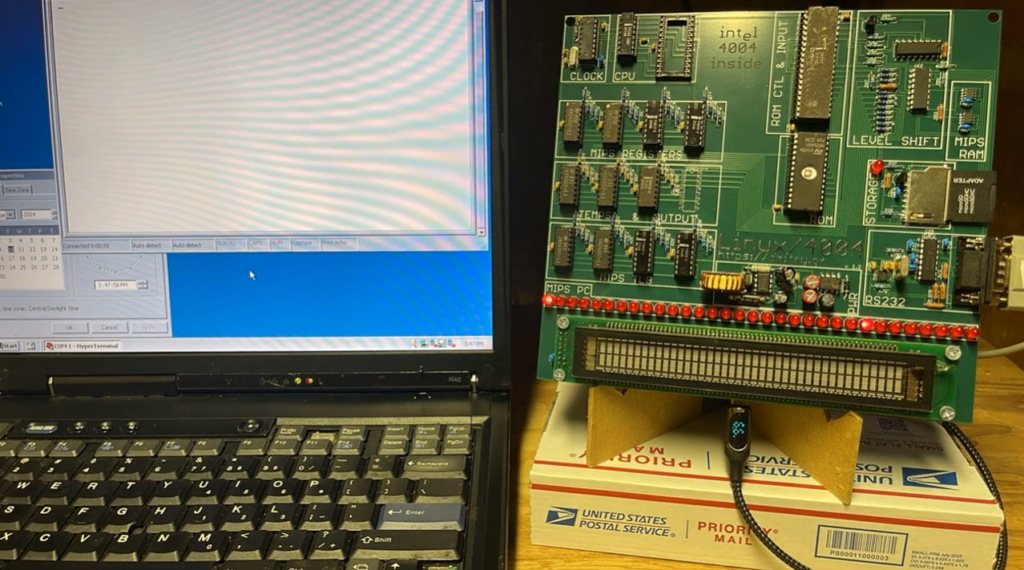

Comme nous avons eu l’occasion de l’expliquer dans la première partie de notre dossier sur les CPU (note à moi-même : penser à le finir…), l’Intel 4004 est le premier microprocesseur à avoir été commercialisé.

Il intégrait pour rappel 2 300 transistors et la puce ne disposait que de 16 pins. Elle était capable d’exécuter 92 600 opérations par seconde avec une vitesse de fonctionnement de 740 kHz. De son côté, le noyau Linux est arrivé 20 ans plus tard, en 1991

Dmitry Grinberg a réussi à booter le noyau Linux de Debian dessus, en seulement 4,76 jours. Quelques précisions pour les sceptiques :

« Bien sûr, Linux ne peut pas et ne veut pas démarrer directement sur un 4004. Il n’y a pas de compilateur C ciblant le 4004, et il n’a pas été possible d’en créer un en raison des limitations de l’architecture. La quantité de ROM et de RAM adressable est également trop faible ».

Solution de contournement : l’émulation. « Mon objectif initial était de rester dans la limite 4 Ko de code, car c’est ce qu’un 4004 non modifié peut gérer. 4 Ko de code, ce n’est pas grand-chose pour émuler un système complet ». Après avoir analysé différentes options, il est parti sur le MIPS R3000.

Le 25 septembre à 06h00

Commentaires (39)

Abonnez-vous pour prendre part au débat

Déjà abonné ? Se connecter

Cet article est en accès libre, mais il est le fruit du travail d'une rédaction qui ne travaille que pour ses lecteurs, sur un média sans pub et sans tracker. Soutenez le journalisme tech de qualité en vous abonnant.

Accédez en illimité aux articles

Profitez d’un média expert et unique

Intégrez la communauté et prenez part aux débats

Partagez des articles premium à vos contacts

Abonnez-vousLe 25/09/2024 à 06h13

Et faire émerger la conscience que les ressources d'aujourd'hui sont peut-être overkill et qu'on peut se contenter de moins?

En tout cas pour des usages de consultation/consommation courants.

Le 25/09/2024 à 06h54

Pour revenir à cette démo:

6.3w pendant 4j pour juste booter c'est 0.7kWh; le pire rendement depuis que les calculateurs à ampoules ont étés arrêtés.

et on ne compte pas le PC a côté qui sert de terminal en port série.

Les heures de développement qu'il a fallu pour programmer ce noyau ça se compte en mois, une gabegie au regard de l'intérêt.

Enfin les ressources matérielles, ce n'est même pas du matériel au rebut qu'un nostalgique aurait voulu faire revivre, la carte a été construite sur mesure.

Donc moi ce que ça m'évoque plutôt, j'hésite entre de la folie ou de l'acharnement.

Le 25/09/2024 à 10h05

Simplement regarder occasionnellement la TV avec l'antenne râteau, jouer avec des vraies cartes ou autres accessoires, aller voir le foot sur le terrain… Les activités personnelles très utiles des ordi ne nécessitent pas autant de puissance… Quant à l'Internet, c'est (aussi) une source de publicités comme si les pub ciblées (comme disait Coluche avec les dragées Fucka suivi d'un produit de nettoyage des toilettes) aujourd'hui on a tout sur les fuites urinaires au moment de l’apéro ou du repas ; comme c'est insuffisant il faut en récupérer d'autres avec la merveilleuse FIBRE.

ON a le jeune voisin qui rêve de s'offrir une GTX?090 avec 48 Go de DDR9 pour pouvoir jouer (s'isoler dans un monde où l'on zigouille du Russes et du Chinois) alors qu'il y a des clubs sportifs ou d'échecs/de dentelles en bas (payés par le contribuable).

Bon, cela dit, j'ai 2 ordi (portable et fixe), une connexion fibre à 5Go, mais un trucphone qui me sert uniquement pour téléphoner, un APN pour la Photo, une liseuse pour la lecture (pas pour me faire la lecture en audio), et pour contrôler la monnaie j'ai quelques vieux souvenirs arithmétiques. Je ne suis donc pas vraiment «IN» !

Le 25/09/2024 à 07h26

Le problème c’est qu’on a des ordinateurs incroyablement puissants mais que les éditeurs de logiciels n’en ont plus rien à faire de la perf donc on se retrouve avec des softs ridiculement lourds qui ne font pas grand chose de plus qu’avant.

Bon après je modère quand même mon propos : j’ai jamais gardé mes machines aussi longtemps. Mon PC fixe sous Linux a 7 ou 8 ans et a part la carte graphique quasi tout est d’origine. Par contre le PC de mon ancien taf (de dev

Mais en tant que dev, j’ai vu de mes yeux que la perf n’est ja-mais un sujet. Économiquement c’est logique : par rapport au salaire d’un dev qui va passer du temps à bien faire (et déjà ça implique plusieurs devs qui débattent pendant des heures de ce que ça veut dire

Et c’est même pas que c’est volontaire ou cynique ou de la malveillance : non, c’est un peu comme le respect de la vie privée ou la sécurité : on dit qu’on s’en occupe, probablement que plein de gens aimeraient que ce soit vrai - ou même pensent que c’est vrai - mais en vrai on est déjà en retard pour livrer les fonctionnalités promises alors bien faire …

Le 25/09/2024 à 11h17

Le 25/09/2024 à 19h09

Le 25/09/2024 à 07h28

Par contre de l'optimisation logicielle oui, par exemple éviter de trop empiler les couches de framework.

Le 25/09/2024 à 08h36

Mais disons qu'un équivalent moderne d'un CPU des années 2000 qui permettait déjà de naviguer sur le web et faire du traitement de texte , serait encore suffisant si les programmes et OS étaient optimisés pour.

Les montres connectées peuvent déjà le faire, et leur CPU est rikiki.

Le 25/09/2024 à 09h16

Le 25/09/2024 à 09h19

Entre image FHD/4K, utilisation de nombreuses librairie JS et d'images dans le template augmente le temps de calcul et l'utilisation de la RAM.

En plus aujourd'hui, on doit isoler chaque site dans un processus différent pour des raisons de sécurité, ce que l'on ne faisait pas à l'époque.

Le 25/09/2024 à 10h37

* Le web d'aujourd'hui est extrêmement consommateur et inefficace (JS, image, calcul CSS via le GPU au pixel - mais pour un résultat peu déterministe)

* L'énorme différence opérée il y a 20 ans niveau sécu, c'est que l'ordi est connecté à l'extérieur, et que la sécurité des données est au-delà du physique

Ceci dit, la séparation des processus est extrêmement dommageable aux perfs surtout sur un CPU mono thread. Au-delà de cela, le web n'utilise pas ou peu le parallélisme.

Mais le constat est réel: téléchargement 4Mo pour 8000 signes effectivement utiles, l'efficacité des ordis actuels est quasi nulle.

Le 25/09/2024 à 19h10

Le 29/09/2024 à 10h51

Le 25/09/2024 à 09h14

Sans parler que les GPU on des performances de bureau convenable dès les fréquences les plus basses.

Le 26/09/2024 à 13h52

Déjà revoir les outils de dev.

Début 2000, ça se battait à savoir combien de fois C est plus performant que Java.

Actuellement on utilise Python à tout va, qui n'est la plupart du temps même pas jitté. Dans tous les frameworks, on accède aux données en mémoire via une indexation par chaîne de caractère - c'est juste immensément consommateur de ressources.

Je ne vais même pas m'étendre sur les applis web...

Ensuite, la sécurité a un énorme coût. La réactivité sous Windows est très liée à tout la partie antivirus. Désactive l'antivirus et l'anti malware et "miracle" Windows est réactif.

Enfin, il y a le service. Noter que dans certaines configuration, l'opération de copier quelque chose (en plus de passer par l'antivirus) est transmis sur internet pour être collable sur un autre ordinateur (je n'en ai jamais eu besoin, mais ça existe, chez Microsoft ou logitech).

Ceci dit: certaines applis (notamment en JS sont absolument bluffantes, comme draw.io)

Le 25/09/2024 à 08h38

Le 25/09/2024 à 08h51

Bon, et l'IA, les petites puces TPU Coral savent se tenir en conso.

Si on veut être raisonnable

Le 25/09/2024 à 09h53

A partir de cette puissance, on a d'un coté les développeurs qui doivent optimiser pour faire entrer leur appli dessus.

Et d'un autre coté, les fabricants de CPU qui doivent minimiser la consommation.

Le 25/09/2024 à 17h52

Modifié le 25/09/2024 à 19h58

PS: j'ai déjà une Switch et je suis impressionné par le développement des deux gros Zelda BOTW et TOTK, qui tournent sur machine aussi anémique. Contrairement au Zelda Link's Awakening qui est une honte avec des chutes de framerates sur un jeu aussi simple.

Le 25/09/2024 à 23h01

Et Nintendo à une approche intéressante du jeu vidéo sur ses consoles : un bon jeu, c'est un jeu qui a un bon gameplay/gamedesign et c'est ensuite que tu y colles l'univers. Ca s'apparente à l'approche bottom-up. Cette approche n'a pas besoin d'une machine puissante (la DA devra être pensé en conséquence : l'univers cartoon permet justement de faire des trucs pas trop moches, mais qui ne demande aucune ressource), mais d'une machine offrant des possibilités de gameplay/gamedesign (les contrôles par exemples).

Le 25/09/2024 à 10h20

Le 25/09/2024 à 15h26

Modifié le 29/09/2024 à 01h11

Quand je voyais à une époque pas très lointaine dans le métro ceux ou celles qui jouaient à CandyCrush Saga, répondre sur WhatsApp et lire des posts sur Facebook avec de l'iPhone 11 ou 12 qui scorent 500 000 points sur Antutu et vu le "profil" de l'utilisatrice ou de l'utilisateur (ménagère de -50 ans et son pendant masculin, ce n'est pas une critique bête et méchante, c'est juste un fait que j'ai pu constaté, point barre... % de geeks, d'ingé en info dans la population ? ).

Je pense que ça devait être les app. les + hardcores & les + exigeantes qu'ils devaient faire tourner sur leurs (nouvelles) bêtes (de course)...

Connaissant quelques fanboys de la marque (mais personne n'est parfait...), je leurs avais posé la question:

" - Mais pourquoi tu changes ton iPhone quasiment tous les ans ? Il tourne déjà super bien, non ?"

" - ouais mais en fait c'est pour l'appareil photo, parce qu'il est (un peu) mieux sur le nouveau que sur le mien... qui date de l'année dernière..."

(et Apple propose un système de rachat de son iPhone directement intégré dans la page d'achat du nouveau iPhone...)

Comme si on faisait des photos de photographe avec un smartphone...?? Dans ce cas si vraiment passionné , il faut aller s'acheter un reflex...

Mes smartphones (d'occaz & sous LineageOS) ont toujours en général 4-5 ans de "retard" sur le dernier né du marché mais pourtant tournent impeccables !

iPhone 16 Pro Antutu score: 2 millions points... pour jouer à CandyCrush saga ou autres équivalents ou voir les photos des mômes des voisins sur Facebook (et comme disait le philosophe Jean-Marie Bigard: " les gamins des autres, c'est comme les prouts, y'a que les siens qu'on arrive à supporter... et encore..."), mais oui il y a sûrement 5%-10% des usagers qui sont des hardcore gamers et qui ont le besoin.

Mais c'est aussi le cœur et le moteur de l'économie mondiale & de la société de consommation... (jusqu'à présent, on n'a pas trouvé mieux, car le communisme

1 - soit des nouveaux modèles (mais qui n'apportent pas grand chose de plus)

2 - soit votre produit, il devient naze ou tout niqué assez rapidement

(1 & 2 ne sont pas mutuellement exclusifs)

Comment dans les années 1930, les plus gros fabricants d'ampoules dans le monde se sont mis d'accord pour réduire la durée de vie à 1000h seulement !! WTF !! quand elles pouvaient durer x3 fois plus longtemps.

Pour info, l'ampoule la plus vieille du monde est dans la caserne de pompiers de Livermore (California) au 4550 East Avenue, surnommée la Centennial Light. Elle est allumée depuis plus de 121 ans et depuis 1901, n'a été éteinte qu'une poignée de fois. (Source: Wiki)

This 120 Year-Old Light Bulb Still Works! (sinon c'était 110 ans en 2011) & Veritasium@ YouTube & Cartel Phœbus

.

Le 25/09/2024 à 09h08

Le 25/09/2024 à 09h18

Le 25/09/2024 à 10h11

Beaucoup trop de visites mon fils.

Le 25/09/2024 à 14h48

Le 25/09/2024 à 10h09

Aujourd’hui, nous abusons des possibilités des CPU/RAM pour toujours plus de décors. Pour ceux qui ont connu les RAM courtes comme des timbres postes pour y loger un roman, il fallait « misez petit, optimisez. » La solution est peut-être par là.

Le 25/09/2024 à 10h38

Le 25/09/2024 à 11h12

Le 25/09/2024 à 21h16

Le 26/09/2024 à 13h32

Ca a été très compliqué à expliquer lors du démarrage de Vista...

Le 25/09/2024 à 11h07

Si vous voulez réutiliser de manière moderne du matos ancien pour le fun installez AntiX linux sur un PIII ou un dual core 1re gen, ce ne sera pas un foudre de guerre mais ça peut être rigolo pour occuper les longues soirées d'hiver.

Ou utilisez un P4 3Ghz si vous manquez vraiment de chauffage

Le 25/09/2024 à 13h01

Le 25/09/2024 à 20h27

Modifié le 26/09/2024 à 00h10

S'il y a bien un endroit où je ne m'attendais pas à encore lire ces absurdités, c'était sur (PC)Next(INpact).

Comme quoi, ne jamais dire jamais…

C'est cela le vrai esprit hacker, bien loin de la petite lucarne rocambolesque que la culture populaire a daigné en conserver.

De vrais "barbus" de tous âges (eh oui) qui nous rappellent qu'un bon artisan avec un outil avec lequel il est à l'aise devient un "magicien", fascinant, captivant à observer/écouter.

Il n'y a pas d'utilité à trouver, que diable ! Votre vie est remplie d'absurdité, et de vide : réalisez-le. Vous qui vous pensez rationnels et pragmatiques, vous êtes des sacs à viande pétris de contradictions, brûlant ressources et énergie à ergoter sur les détails de notre insignifiante vie.

Souvenez-vous qu'une part de votre héritage sait dépasser le Sapiens pour retrouver un brin de Néandertal : la beauté à sa part de légitimité, et elle n'a pas à être contrainte par l'utilité.

Je trouve ce genre de projet brillant de créativité, débordant de talent et ultimement inspirant.

Et certainement y a-t-il eu pléthore d'apprentissages, car les obstacles ont du être nombreux, de tous types, et bien évidemment survenant là où ils étaient les moins anticipés.

Une vraie leçon de vie, en somme, que les stériles TV sur antenne râteau ou football sur un terrain ne vous apporteront jamais.

Modifié le 26/09/2024 à 10h13

Parler de Néandertal comme d'un hacker brillant de créativité, c'est du négationnisme ?

Ou alors il a trouvé le Sapiens tellement con qu'il a brulé toutes ses œuvres et s'est suicidé pour qu'on ne profite jamais de son talent débordant.

C'est la seule explication crédible pour retomber sur ses pattes.

Edith:

J'ai mieux : ils s'étaient pris de passion pour la chasse au lapin à coup de menhirs, c'était un peu comme les jeux olympiques chez eux : une démonstration de leur puissance.

Mais cette passion que tout le monde pratiquait a mené à leur perte parce qu'un lapin écrasé ça ne nourrit pas son homme et les petits bouts d'os brisés leur abimait le transit.

Le 30/09/2024 à 03h27